No degradarás en vano la inteligencia humana

«Cuando el lenguaje pierde el significado, no puede existir

ninguna forma de verdad y la mentira se convierte en norma.«

«Somos confrontados con el refinado arte de la mentira

y el torcimiento del significado de las palabras. «

Rob Riemen («Para combatir esta era:

Consideraciones urgentes sobre fascismo y humanismo«)

En La Vanguardia, un artículo sobre la inteligencia artificial de uno de sus colaboradores habituales, se me antoja una buena muestra del perceptivo diagnóstico de Jaron Lanier acerca de las perspectivas e intenciones sesgadas de muchos tecnófilos:

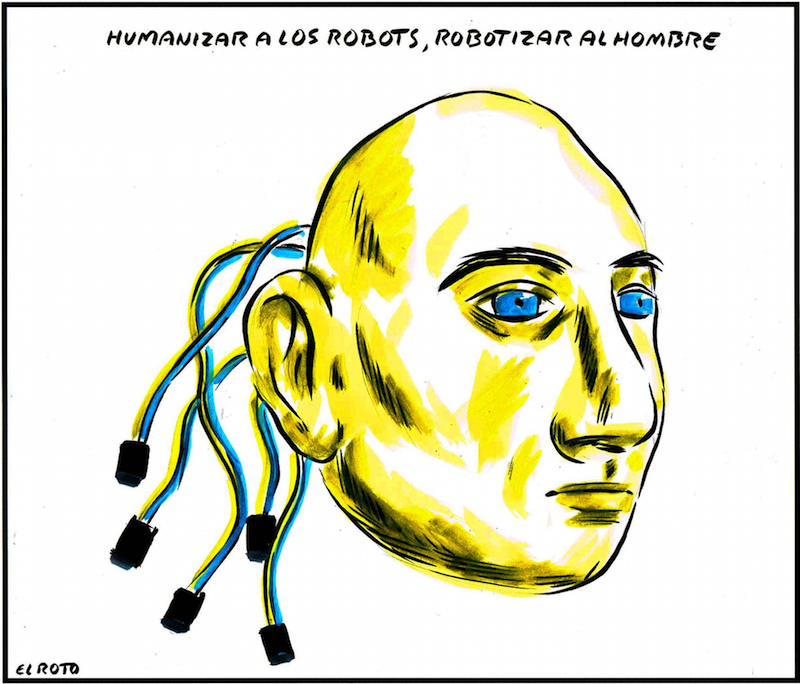

«Hacen a las personas obsoletas para que las máquinas parezcan más avanzadas.»

Jaron Lanier, «You are not a gadget«

Una manifestación visible de este sesgo es que el autor considere estimulante definir la inteligencia como «todo lo que las máquinas aún no han hecho«. Una definición que, a medida que se avance en las capacidades de la IA, lleva a considerar como cada vez menos inteligentes a los humanos. De ahí a degradar a los propios humanos a favor de las máquinas hay sólo un (pequeño) paso. Que algunos los explotadores de la condición humana, en alianza con algunos vendedores de máquinas sin escrúpulos, estarán encantados de dar.

Me parece pues apropiado aplicar un poco de autodefensa intelectual y de ejercicio de la dialéctica. Empezando por no aceptar las trampas del argumentario del autor.

- Aprovecharse de la homonimia. No hay una única definición de inteligencia. Si, de entre las que propone la Wikipedia, por ejemplo, escogiéramos «la capacidad agregada o global de actuar con propósito, de pensar racionalmente y de manejar eficazmente su entorno«, difícilmente calificaríamos a los ordenadores como inteligentes. Quizá sea tarde para evitar que se utilice la misma palabra (‘inteligencia’) para referirse a capacidades diferentes; pero no lo es para tomar conciencia de las consecuencias de hacerlo; sobre todo de las mal intencionadas, que las hay.

- La falta de rigor en el uso del lenguaje. El autor presenta la IA como «la disciplina que se encarga de dotar a los ordenadores de las capacidades cognitivas que hasta ahora eran exclusivas de los humanos«. Si entendemos la cognición como «el proceso de conocer y comprender por medio del pensamiento, la experiencia y los sentidos», la IA no tiene capacidades cognitivas. Porque nadie comprende (hoy por hoy) cómo los algoritmos de IA más avanzados producen los resultados que producen; y mucho menos los propios algoritmos.

- La asignación antidemocrática de responsabilidades. Para el autor, definir la inteligencia humana en negativo (lo que los ordenadores aún no son capaces de hacer) es interesante porque «nos obliga a redefinirnos a nosotros mismos«. La IA es un desarrollo impulsado por una minoría, que en principio persigue sus propios intereses. Conceder sin más el poder de que se nos obligue a redefinirnos como humanos es, en el fondo, de lo más antidemocrático.

Hay quien propone que 2019 sea el año en que se empiecen a poner límites al desarrollo y la aplicación acrítica de las tecnologías. Una tarea que incluiría desmontar con rigor la argumentación (no sé si ingenua o falaz) de escritos como el comentado. ¿Alguien se apunta?