Salir de la burbuja, sea cual sea el color

Hace unos meses, el director de la revista The New Yorker propuso invitar a Steve Bannon, un ideólogo de la derecha radical a su ciclo de conferencias de otoño. La noticia generó una reacción negativa airada, ampliamente difundida en los medios y en las redes sociales, además del rechazo de algún otro invitado al evento a compartir escenario con Bannon. En consecuencia, The New Yorker acabó por retirar la invitación.

No todos los lectores respaldaron la decisión de la revista. Creo que vale la pena reproducir (en una traducción levemente editada) la carta de uno de los que se opuso (publicada por la propia revista):

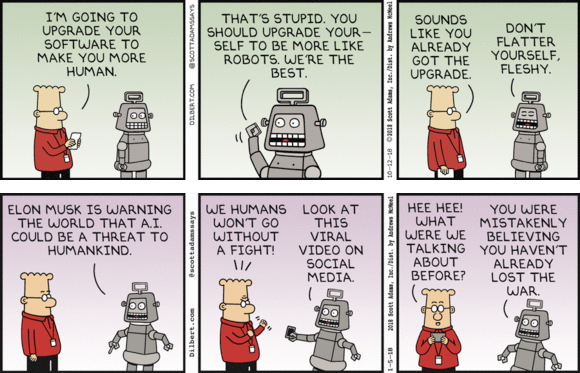

«Como demócrata liberal de toda la vida, me siento profundamente desanimado por la decisión de cancelar la aparición de Bannon en el Festival. Me decepcionan también artistas a los que admiro y con los que estoy en general de acuerdo, que se han retirado del Festival en respuesta a la participación de Bannon. Bannon es un hombre muy inteligente cuyos puntos de vista son, para mí, malvados, destructivos e inaceptables. Entrevistarle en un foro como el Festival habría sido una oportunidad para que un público de inclinaciones liberales escuchara de primera mano el funcionamiento de esa mente. Pero no, hay quien en esa izquierda liberal ilustrada prefiere no escucharlo en absoluto. Por lo cual sabremos mucho menos. ¿Cuándo se volvió la izquierda tan reaccionaria como la extrema derecha?«

Más o menos en las mismas fechas, The Economist también invitó a Bannon a su Open Future Festival. Sin embargo, a diferencia de lo que hizo The New Yorker, mantuvo la invitación a pesar de las críticas. Reproduzco también el razonamiento del editor:

«Nuestro objetivo es rehacer el caso de los valores liberales en el siglo XXI entablando una conversación global sobre nuestra visión del mundo con nuestros partidarios y, fundamentalmente, con nuestros críticos.

[…] El progreso se logra mejor cuando las ideas se ponen a prueba en un debate abierto […] El Sr. Bannon defiende una visión del mundo que es antitética a los valores liberales que The Economist siempre ha defendido. Le pedimos que participara porque su nacionalismo populista tiene graves consecuencias en la política actual. Ayudó a llevar a Donald Trump a la Casa Blanca y está asesorando a la extrema derecha populista en varios países europeos donde están cerca del poder o en el gobierno. Es preocupante que un gran número de personas se sientan atraídas por el nacionalismo nativista. Y el señor Bannon es uno de sus principales proponentes.

El futuro de las sociedades abiertas no estará asegurado por personas de ideas afines hablándose en una cámara de eco, sino sometiendo a ideas e individuos de todo tipo a preguntas y debates rigurosos. Esto expondrá el fanatismo y los prejuicios, al igual que reafirmará y refrescará el liberalismo. […] Cuando James Wilson lanzó este periódico en 1843, dijo que su misión era participar en «una dura competencia entre la inteligencia, que avanza, y una ignorancia indigna y tímida que obstruye nuestro progreso». Esas palabras nos han guiado durante 175 años […] Es por eso que nuestra invitación al Sr. Bannon se mantendrá.»

Personalmente encuentro en falta este talante en nuestro entorno. Escasea en todos los colores del espectro ideológico y político.

En

En