Mark Zuckerberg ha cumplido una de sus promesas. aunque quizá no del modo en que lo imaginaba.

Hace unos años. en una carta dirigida a los potenciales accionistas en ocasión de la salida a Bolsa de Facebook, su CEO manifestaba que

«Tenemos un lema: Move fast and break things.«

Con el incidente de Cambridge Analytica y su posterior gestión, Facebook ha quebrado, en efecto, la confianza de inversores y usuarios bien intencionados, a una escala que The Economist califica como un fallo épico (‘epic fail‘) en una implacable imagen de portada.

Sería demasiado fácil añadir más madera a la ya abundante leña publicada sobre el árbol caído. Aparte de recomendar la lectura, con la perspectiva de hoy, de la comunicación de 2012 a sus futuros accionistas, me interesa comentar un aspecto de las manifestaciones que Zuckerberg hace acerca de su visión del futuro en una entrevista en Vox.

Empieza confirmando su afirmación anterior de que Facebook se parece más a un gobierno que a una empresa tradicional, ofreciéndose como árbitro y regulador de enfrentamientos que tienen lugar en su red:

«La gente comparte muchos contenidos y en ocasiones hay disputas acerca de si un contenido es aceptable […] Estamos en la posición, más que otras compañías, de arbitrar en estas disputas entre diferentes miembros de nuestra comunidad. Y para ello hemos tenido que construir un conjunto completo de políticas y de gobernanzas.»

A continuación, aún admitiendo que «no es evidente que una oficina en California sea la mejor ubicación para determinar políticas para gentes de todo el mundo» se reafirma en su objetivo de intentarlo, adoptando el rol de un dictador benevolente.

«Mi objetivo es crear una estructura de gobernanza en torno a los contenidos y la comunidad que refleje mejor lo que la gente quiere que lo que puedan querer los accionistas orientados al corto plazo.»

Aún admitiendo que Zuckerberg sea sincero, ¿se trata de un objetivo realista? ¿Es concebible que pueda crearse de arriba hacia abajo una tal estructura de gobernanza para una colectivo tan amplio? Más aún cuando, aunque Zuckerberg insista en lo contrario, el colectivo de usuarios de Facebook no constituye una comunidad – según Facebook sólo un 5% de sus usuarios forman parte de grupos con sentido. Para la mayoría, su común unidad se limita a utilizar Facebook.

La misma reserva, dicho sea de paso, puede aplicarse a muchas de las propuestas de regular Facebook desde los poderes públicos, aunque sólo sea porque muchas Administraciones tienen también tendencias de dictador benevolente.

Una alternativa sería, en la línea de las propuestas de la Premio Nobel de Economía Elinor Olson, dar a los usuarios la capacidad de crear sus propias reglas. La dificultad, claro está, es que ello exigiría al dictador benevolente y a sus accionistas dos compromisos radicales.

- Considerar como bien común los contenidos que aportan los usuarios.

- Adoptar los principios de diseño bottom-up de comunidades, en la línea de los propuestos por Elinor Ostrom (accesibles aquí), que configuran un tipo de organización en varios niveles, cada uno de ellos autogestionado.

Una propuesta que a buen seguro encontrará muchas resistencias, porque conllevaría la obligación de gestionar independientemente la red social y el negocio publicitario de Facebook, y por extensión el de empresas con un modelo de negocio similar.

¿Qué esperar pues? Pienso, y me gustaría equivocarme, que poco progreso a corto plazo. Porque los dictadores benevolentes también tienen su tribu.

La verdad es que …

/0 Comentarios/en Filosofía /por Ricard Ruiz de QuerolVivimos en tiempos complejos y confusos, llenos de tensiones y contradicciones. Cuesta separar el grano de la paja, distinguir entre apariencia y realidad, entre esencia y oropel, entre auténtico y postizo, entre verdadero y falso. Como ilustra la viñeta de The New Yorker, la búsqueda de ‘la verdad’, incluso de verdades parciales se está convirtiendo en algo cada vez más fatigoso.

Lo cual, aunque pueda parecer contradictorio, nos lleva a desconfiar de las nuevas utopías y de la autoridad intelectual y ética de quienes proclaman sus bondades (ilustrativo a este respecto, el artículo de Manuel Cruz en El País). También a cuestionar algunas innovaciones disruptivas, el ‘move fast and break thinks’ que algunos presentan, sin argumentos, como un imperativo ineludible, como el signo de los tiempos. Incluyendo futuros (del trabajo, del humanismo, del conocimiento, de la vida en sociedad) que nos presentan como consecuencia del impacto de la tecnología cuando tenemos motivos para sospechar que son más bien proyectos de futuro de algunos que esgrimen las tecnologías (sus tecnologías) como herramientas para acumular (todavía más) riqueza y poder.

Total, que cuando vuelva a escuchar a alguien empezar una frase con la coletilla «La verdad es que …«, cada vez más habitual, tendré la tentación por preguntarle por la naturaleza de la verdad. A saber qué contesta.

P.S. Creo que, en lugar de apuntarme a un curso de escritura cuando me jubile, lo hará a uno de dibujar viñetas.

Quizá convendría que se miraran al espejo

/0 Comentarios/en Caórdica /por Ricard Ruiz de QuerolQuizá convendría que se miraran al espejo. O que pidieran feedback. No hace falta que apunte nombres. Apuesto que cada cual podría proponer los suyos, y que las listas de unos y otros (o unas y otras, o unos y otras, o unas y otros) no serían necesariamente coincidentes.

Inocular el virus Bartleby a según qué ciencia

/0 Comentarios/en Ciencias /por Ricard Ruiz de QuerolEl protagonista de esta novela confiesa su empeño en rastrear el «amplio espectro del síndrome de Bartley en la literatura«, un síndrome cuya manifestación es

Lo que me lleva a mencionar el síndrome Bartebly es una entrevista en El País Ideas (12/8/2018) con Max Tegmark, un físico teórico de MIT, a raíz de la publicación de su libro («Vida 3.0: Ser humano en la era de la inteligencia Artificial«). Si hubiera tenido en la memoria la novela de Vila-Matas cuando leí («Our Mathematical Universe«), una obra anterior de Tegmark, es posible que no hubiera podido resistirme al malévolo deseo de que fuera de algún modo, como escribiente, afectado por el síndrome Bartleby y se centrara en publicar sólo para la comunidad científica. Ahora sería aún más radical.

En la entrevista para El País, Tegmark manifiesta esta preocupación:

El motivo, según su punto de vista, es que:

Su propuesta:

Una dificultad obvia es la muy alta probabilidad de que quienes paguen a esos psicólogos, sociólogos o economistas sean las mismas empresas que financian la investigación de los científicos «idealistas», y que lo hagan con el mismo objetivo prioritario de ganar dinero.

Inspirado por Vila-Matas, se me ocurre que una alternativa, quizá igualmente improbable pero por qué no, sería inocular un virus Bartleby a los científicos que, desde un idealismo simplista, cuando no socialmente irresponsable, empujan el desarrollo de unas tecnologías cuyo control social ellos mismos reconocen como problemático. Sería bonito, quizá demasiado bonito, que el propio Tegmark fuera el primero en dar ejemplo.

Pre-juicios de la tecnociencia

/0 Comentarios/en Ciencias, Filosofía /por Ricard Ruiz de QuerolAfirma categóricamente que:

Me resisto a darle la razón. En parte porque entiendo que su afirmación no es el resultado de una investigación, sino de un pre-juicio ‘a priori’. Porque intuyo como mucho más verdadera la perspectiva del filósofo Markus Gabriel, que comentaba en una entrada anterior:

De otra parte, ¿qué pensaríamos de una afirmación como la siguiente?

Creo evidente que cualquiera con un mínimo entendimiento sobre ordenadores y computación desaconsejaría por poco práctica una propuesta de este tipo. Porque:

Ya puestos en plan escéptico, añadiría que:

Mis conclusiones:

(1) El cerebro es un instrumento del pensar. Pero para entender el pensar habrá que mirar más allá del cerebro. Igual que para entender el tiempo hay mejores maneras que investigar cómo funciona uno de esos relojes con muchas complicaciones en los que los relojeros suizos son tan expertos.

(2) El problema con algunos científicos no es que sean ignorantes; es que, como ocurre a tantas personas, son más ignorantes de lo que se creen.

(3) Sobre las posibles reacciones a una entrada como ésta, recordar la advertencia de Bertrand Rusell: «Las opiniones más apasionadas son siempre aquellas para las que no existe fundamento«.

Dicho ésto, me encantará participar en un debate sobre los límites de la ciencia y este tipo de cuestiones.

Efectos secundarios del impulso de estar informado

/0 Comentarios/en Filosofía /por RuizdeQuerolNo añadiría ni una palabra más a estas imágenes. Excepto, quizá, mencionar la envidia que me dan estos dibujantes de The New Yorker.

Fuentes:

Cuando su ‘nosotros’ es nuestro ‘ellos’, por ahora

/0 Comentarios/en Economía, Social, Tecnológica y Digital /por Ricard Ruiz de QuerolFoto: Miguel Orós

La reflexión de Berners-Lee sobre Internet comentada en una entrada anterior nos alerta de que el impacto social de la tecnología no es siempre ni el deseado ni el previsto. Ha sido así en el pasado, y no hay motivos para creer que dejará de ser así en adelante, en particular con las tecnologías que se engloban bajo el lema de la Revolución Industrial 4.0: la inteligencia artificial, el Big Data, la Internet de las cosas, la robótica, la realidad aumentada y algunas que seguramente olvido.

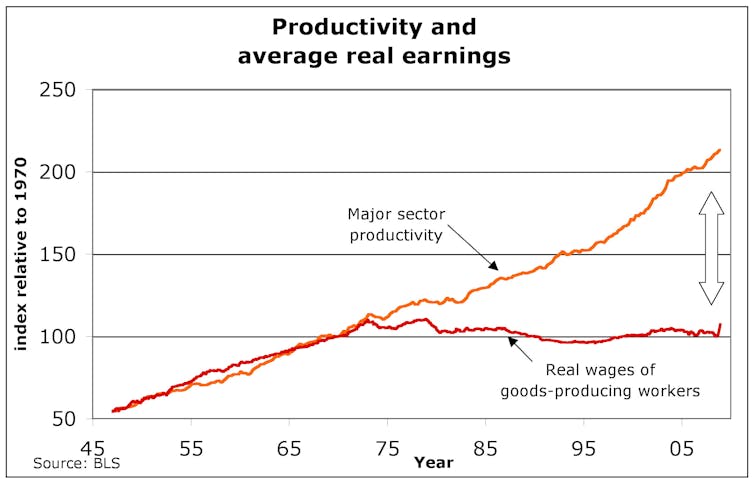

Parece pues obligado leer con precaución, cuando no con desconfianza, los argumentos del ‘status quo’, como el World Economic Forum a favor de esa nueva revolución tecnológica. Usaré como ejemplo una publicación reciente: «Robots have been taking our jobs for 50 years, so why are we worried?«. Su argumento central es ya toda una declaración de principios:

El impulso al desarrollo de esa tecnología 4.0 se da por hecho, aún admitiendo la incertidumbre sobre «el impacto exacto que una fuerza de trabajo robótica con el potencial de operar de forma autónoma tendrá en la industria productiva». Se cita como precedente que cuando la introducción de una tecnología ha convertido a los humanos en redundantes «les ha forzado a adaptarse», lo cual es también una declaración de valore. Unos deciden desarrollar e implantar una tecnología; otros se ven forzados a adaptarse. Aunque esta adaptación forzosa suponga, por ejemplo, el desacople entre los aumentos de productividad y los salarios que viene constatándose desde hace ya algunas décadas. Lo que se sí se argumenta es que en un escenario ideal, la Industria 4.0 «permitiría a las personas enfocarse más en aquello que nos hace humanos«. Posible, pero improbable. Porque, como observa un académico en ciernes, «entendemos mucho mejor cómo trabajan los robots que cómo lo hacemos nosotros». Pero, sobre todo, porque se omite todo detalle sobre las características de este escenario ideal, sobre cómo construirlo, así como el modo de combatir la aparición de otros escenarios menos ideales impulsados desde el lado oscuro.

Lo que se sí se argumenta es que en un escenario ideal, la Industria 4.0 «permitiría a las personas enfocarse más en aquello que nos hace humanos«. Posible, pero improbable. Porque, como observa un académico en ciernes, «entendemos mucho mejor cómo trabajan los robots que cómo lo hacemos nosotros». Pero, sobre todo, porque se omite todo detalle sobre las características de este escenario ideal, sobre cómo construirlo, así como el modo de combatir la aparición de otros escenarios menos ideales impulsados desde el lado oscuro.

El artículo cierra con una frase deliberadamente ambigua:

Ambigua, porque la naturaleza de este nosotros no queda en absoluto clara. Alguien observó certeramente que «cuando se habla en nombre del pueblo es que no se tiene argumentos creíbles y sensatos«. Pues eso. Me temo que, por lo menos de momento, su ‘nosotros’ es nuestro ‘ellos’.

WWW: La tragedia de las buenas intenciones

/1 Comentario/en Social, Tecnológica y Digital /por Ricard Ruiz de QuerolImagen: Berners-Lee en el CERN en 1994. © 1994–2018 Cern.

En una entrevista en Vanity Fair, Tim Berners-Lee, el inventor de la Web, afirma que:

Habla de la creciente centralización de la Web, del escándalo de Facebook y Cambridge Analytica, de la influencia en la elección de Donald Trump, del asalto a la privacidad individual por parte de empresas y Gobiernos, del crecimiento de las desigualdades. La lista de efectos secundarios negativos es larga y relevante.

Lo que acongoja a Berners-Lee es que esos daños colaterales se han producido no sólo sin una acción deliberada de las personas que diseñaron la plataforma, sino incluso en contra de sus buenas intenciones.

La clave, ahora evidente, es que Berners-Lee regaló su innovación al mundo sin condiciones. Esperando que fuera una plataforma para lo mejor pero sin incluir protecciones contra lo peor. Hay algo que aprender de esa tragedia personal, de la que Berners-Lee afirma sentirse en parte responsable.

Pero lo es sólo en parte, porque el estado actual de la Web no sería tal sin la negligencia o falta de visión de millones de usuarios, consumidores y ciudadanos perezosos, que durante décadas hemos firmado, sin siquiera leerlo, el consentimiento hacia el modo en que los Googles y Facebooks usan nuestros datos y acumulan dinero y poder.

También hay que apuntar a la falta de escrúpulos sociales de la industria de capital riesgo que se apuntó enseguida a explotar a su favor la ideología del winner-takes-it-all, hoy dominante en el mundo de la tecnología.

Y no pasar por alto la falta de visión (o directamente negligencia) de los poderes públicos que no intervinieron a tiempo para establecer unas reglas de juego alternativas al despliegue de la Web y sus aplicaciones, apoyando sin espíritu crítico las estrategias de aquellos cuyo dominio hoy cuestionan.

Valdría la pena, pienso, tomar conciencia de esta historia ante el despliegue de la propaganda sobre las bondades de la nueva ola tecnológica 4.0. La mayoría de la gente cree que Internet es buena para ellos como individuos, pero no tanto para la sociedad. Se equivocan. Del mismo modo que lo hacen quienes caen en la falacia de la superioridad ilusoria (la que tiene lugar cuando la mayoría de individuos de un colectivo cree ser superior a la media de ese mismo colectivo).

Más sobre todas estas cosas en próximas entradas.

Internautas: ¿egoístas o inconscientes?

/1 Comentario/en Social, Tecnológica y Digital /por Ricard Ruiz de QuerolUna interpretación plausible pasaría por considerar que los datos son el reflejo de una sociedad individualista.

Pero es a la vez posible que apunten a un conocido sesgo cognitivo: la mayoría de los estudiantes en las escuelas de élite creen que son mejores que la media de sus compañeros; la mayoría de las personas creen que son menos sectarias que la media. Quizá, piensen algunos, el usuario medio no sepa protegerse de los riesgos, pero yo controlo. Etcétera.

Los resultados de otra encuesta de la misma fuente, esta vez sobre la percepción del impacto de los ‘social media‘, entre los más jóvenes (89% de los cuales se conectan como mínimo varias veces al día) proporcionan un motivo adicional de reflexión : Sólo el 31% de los jóvenes encuestados considera que el efecto de los ‘social media‘ sea positivo, mientras que el 24% considera que son mayormente nocivos y el resto no se manifiesta claramente en uno u otro sentido.

Recuerdo una vez más un cita de Langdon Winner:

Con un único matiz:

Paywalls: Un estímulo para no dilapidar la atención

/0 Comentarios/en Caórdica /por Ricard Ruiz de QuerolSupongo que no soy el único que debe haber notado últimamente la tendencia de muchas publicaciones electrónicas de poner fin el acceso ilimitado (iba a decir libre, pero la libertad es otra cosa) a sus contenidos. Los ejemplos, por nombrar sólo algunas de aquéllas que tienen la gentileza de enviarme regularmente un correo electrónico con los titulares de sus contenidos, incluyen el New York Times, el Washington Post, Wired, Business Week o Medium (además de otras a las que estoy suscrito hace tiempo, como The Economist o The New Yorker).

Debo confesar que en un principio esta tendencia me irritó, por cuanto no me parecería sensato afrontar el gasto de tantas suscripciones, aparte de que el conjunto de sus contenidos tendría una dosis alta de redundancia. Un artículo en Techcrunch sobre este asunto me ha hecho, sin embargo, cambiar de postura. Por dos motivos.

El primero es personal. Veo ahora esta limitación en el número de fuentes electrónicas a las que pueda acceder como un estímulo a decidir conscientemente hacia dónde enfocar mi atención. Creo que muchos fuimos ingenuos considerando como deseable un futuro en que toda la información del mundo fuera fácilmente accesible para todo el mundo. Porque ese futuro utópico conlleva también «La paradoja de la elección«, sobre la que otros han escrito mejor de lo que yo podría hacerlo aquí.

Resumiendo. Retomando la conciencia de que «There’s no such thing as a free lunch», estoy escogiendo pagar con dinero mejor que con el alma.

Zuckerberg: ¿Un dictador benevolente?

/0 Comentarios/en Política, Social, Tecnológica y Digital, Transformación /por Ricard Ruiz de QuerolMark Zuckerberg ha cumplido una de sus promesas. aunque quizá no del modo en que lo imaginaba.

Hace unos años. en una carta dirigida a los potenciales accionistas en ocasión de la salida a Bolsa de Facebook, su CEO manifestaba que

Con el incidente de Cambridge Analytica y su posterior gestión, Facebook ha quebrado, en efecto, la confianza de inversores y usuarios bien intencionados, a una escala que The Economist califica como un fallo épico (‘epic fail‘) en una implacable imagen de portada.

Sería demasiado fácil añadir más madera a la ya abundante leña publicada sobre el árbol caído. Aparte de recomendar la lectura, con la perspectiva de hoy, de la comunicación de 2012 a sus futuros accionistas, me interesa comentar un aspecto de las manifestaciones que Zuckerberg hace acerca de su visión del futuro en una entrevista en Vox.

Empieza confirmando su afirmación anterior de que Facebook se parece más a un gobierno que a una empresa tradicional, ofreciéndose como árbitro y regulador de enfrentamientos que tienen lugar en su red:

A continuación, aún admitiendo que «no es evidente que una oficina en California sea la mejor ubicación para determinar políticas para gentes de todo el mundo» se reafirma en su objetivo de intentarlo, adoptando el rol de un dictador benevolente.

Aún admitiendo que Zuckerberg sea sincero, ¿se trata de un objetivo realista? ¿Es concebible que pueda crearse de arriba hacia abajo una tal estructura de gobernanza para una colectivo tan amplio? Más aún cuando, aunque Zuckerberg insista en lo contrario, el colectivo de usuarios de Facebook no constituye una comunidad – según Facebook sólo un 5% de sus usuarios forman parte de grupos con sentido. Para la mayoría, su común unidad se limita a utilizar Facebook.

La misma reserva, dicho sea de paso, puede aplicarse a muchas de las propuestas de regular Facebook desde los poderes públicos, aunque sólo sea porque muchas Administraciones tienen también tendencias de dictador benevolente.

Una alternativa sería, en la línea de las propuestas de la Premio Nobel de Economía Elinor Olson, dar a los usuarios la capacidad de crear sus propias reglas. La dificultad, claro está, es que ello exigiría al dictador benevolente y a sus accionistas dos compromisos radicales.

Una propuesta que a buen seguro encontrará muchas resistencias, porque conllevaría la obligación de gestionar independientemente la red social y el negocio publicitario de Facebook, y por extensión el de empresas con un modelo de negocio similar.

¿Qué esperar pues? Pienso, y me gustaría equivocarme, que poco progreso a corto plazo. Porque los dictadores benevolentes también tienen su tribu.